يحتوي كل من آي-فون 12 برو وآي-باد برو 2020 على مستشعر جديد يضيف المسح العميق للمشهد للحصول على صور أفضل يسمى Lidar، لكن المستقبل يشير إلى ما هو أبعد من ذلك، وتتفائل آبل بهذه التقنية وتعول عليها كثيرا، وهي تقنية جديدة تمامًا مقتصرة على سلسلة آي-فون 12، وتحديداً آي-فون 12 برو وآي-فون 12 برو ماكس. ومستشعر Lidar عبارة عن نقطة سوداء بالقرب من عدسات الكاميرا الخلفية، بنفس حجم الفلاش تقريبًا، وهو نوع جديد من مستشعرات العمق يمكن أن يحدث فرقًا في كثير من النواحي والمثيرة للاهتمام. وهو مصطلح ستبدأ في سماعه كثيرًا في الأيام المقبلة، لذا دعونا نتعرف عليه أكثر، وما الغرض الذي جعل أبل تطوره؟ وأين يمكن أن تتجه التكنولوجيا بعد ذلك؟

ماذا يعني Lidar ؟

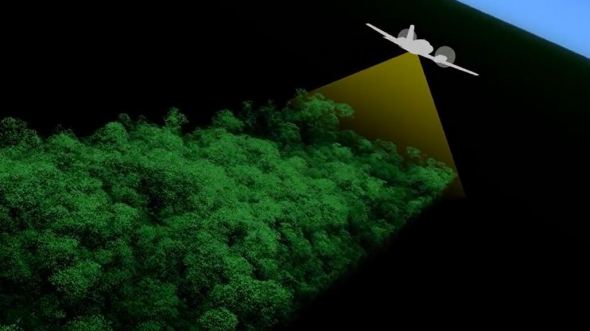

كلمة Lidar اختصار لـ “Light Detection and Ranging” بمعنى الكشف عن الضوء وتحديد المدى “المسافة” عن طريق إضاءة الهدف ومسحه بأشعة الليزر ثم عودتها إلى المصدر مرة أخرى ثم يتم قياس هذا الانعكاس وأوقات عودة تلك الأشعة وأطوال الموجات لإنشاء نماذج رقمية ثلاثية الأبعاد للهدف، وهذا يتم في أجزاء من الثانية.

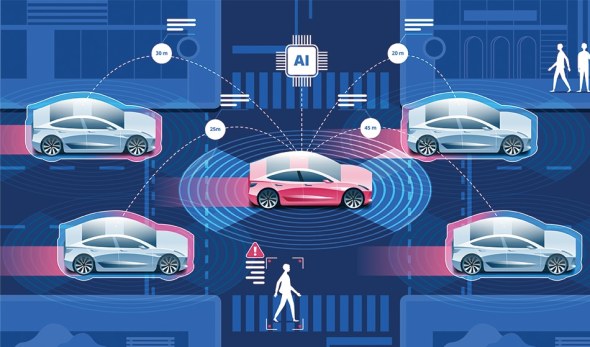

وتستخدم تقنية الـ Lidar بشكل شائع في إنشاء خرائط عالية الدقة، ويستخدم أيضا في الآثار والجغرافيا والجيولوجيا والزلازل والغابات والغلاف الجوي، و قياس الارتفاعات، والتحكم في السيارات ذاتية القيادة، وغير ذلك.

تاريخ تقنية الـ Lidar

جذور تلك التقنية تعود إلى عام 1930 حيث نشأ المفهوم الأساسي لتقنية الـ Lidar وكان مقتصرا على استخدام كشافات قوية لاستكشاف الأرض والغلاف الجوي. ثم تم استخدامه منذ ذلك الحين على نطاق واسع في أبحاث الغلاف الجوي والأرصاد الجوية.

ولكن بداية التطور الكبير لهذه التقنية والانتشار كانت في عام 1961 أي بعد اختراع الليزر بوقت قصير، حيث قدمت شركة هيوز للطائرات في ذلك الوقت أول نظام يشبه الليدار مخصص لتتبع الأقمار الصناعية، يجمع بين التصوير الذي يركز على الليزر والقدرة على حساب المسافات عن طريق قياس وقت عودة الإشارة باستخدام أجهزة الاستشعار المناسبة وإلكترونيات الحصول على البيانات، وكان يطلق عليه في الأصل “Colidar” وهو اختصار لـ “Coherent Light Detecting and Ranging” ، وهو مشتق من مصطلح “الرادار”.

إلا أن LiDAR لم يحصل على الشعبية التي يستحقها إلا بعد عشرين عامًا. فقط خلال الثمانينيات بعد إدخال نظام تحديد المواقع العالمي (GPS) أصبح طريقة شائعة لحساب القياسات الجغرافية المكانية الدقيقة. ,الآن انتشر نطاق تلك التقنية عبر العديد من المجالات.

كيف يعمل الليدار لاستشعار العمق؟

Lidar هو نوع من كاميرات Time-Of-Flight، تقيس بعض الهواتف الذكية الأخرى العمق بنبضة ضوئية واحدة، في حين أن الآي-فون الذي يستخدم هذا النوع من تقنية الليدار يرسل موجات من نبضات الليزر في شبكة من نقاط الأشعة تحت الحمراء، وهي نبضات ضوء غير مرئية للعين البشرية، لكن يمكنك رؤيتها باستخدام كاميرا للرؤية الليلية، ثم يتم حساب المسافات المتغيرة لجسم ما في المشهد. وتولد هذه النبضات الضوئية، جنبًا إلى جنب مع المعلومات التي يتم جمعها بواسطة النظام، معلومات ثلاثية الأبعاد دقيقة المشهد والجسم المستهدف، ثم تأتي العناصر الأخرى مثل المعالج وباقي المكونات بدورها في جمع البيانات وتحليلها وإخراج النتيجة النهاية للعمل على أكمل وجه.

يتبع LiDAR مبدأ بسيطًا، إلقاء ضوء الليزر على جسم ما وحساب الوقت المستغرق للعودة إلى مستشعر LiDAR. بالنظر إلى السرعة التي ينتقل بها الضوء “حوالي 186000 ميل في الثانية” ، فإن عملية قياس المسافة الدقيقة عبر LiDAR تبدو سريعة بشكل لا يصدق.

أليس مستشعر ليدار يشبه مستشعرات Face ID ؟

هو كذلك، ولكن مع مدى أطول. الفكرة هي نفسها، حيث تعمل كاميرا TrueDepth في Face ID على إطلاق مجموعة من أشعة الليزر تحت الحمراء، ولكن مداها قصير ولا تعمل إلا على بعد أقدام قليلة. بينما تعمل مستشعرات الليدار على مدى يصل إلى 5 أمتار!

مستشعر ليدار موجود بالفعل في الكثير من التقنيات الأخرى

LiDAR هي تقنية منتشرة في كل مكان. يتم استخدامها في السيارات ذاتية القيادة أو القيادة المساعدة. يتم استخدامها في الروبوتات والطائرات بدون طيار. وتتمتع أجهزة الرأس الخاصة بالواقع المعزز مثل HoloLens 2 بتقنية مماثلة، حيث تحدد مساحات الغرفة قبل وضع كائنات افتراضية ثلاثية الأبعاد فيها. وتقنية الليدار كما ذكرنا آنفا لها أيضًا تاريخ طويل جدًا.

كان ملحق إكس بوكس القديم الذي يستشعر العمق Kinect من Microsoft، عبارة عن كاميرا بها مسح عمق بالأشعة تحت الحمراء أيضًا. واستحوذت أبل على شركة Prime Sense، الشركة التي ساعدت في صنع تقنية Kinect، في عام 2013. والآن، لدينا تقنية TrueDepth الذي يعمل على مسح الوجه، ومستشعر LiDAR في مجموعة الكاميرا الخلفية لآي-فون 12 برو الذي يعمل على اكتشاف العمق بشكل أكبر.

تعمل كاميرا آي-فون 12 برو بشكل أفضل مع مستشعر lidar

تميل كاميرات وقت الرحلة Time-Of-Flight على الهواتف الذكية إلى استخدامها لتحسين الدقة وسرعة التركيز، ويقوم آي-فون 12 برو بنفس الشيء مع التركيز بشكل أفضل وأسرع على تحسين الإضاءة المنخفضة، حتى ست مرات من ظروف الإضاءة المنخفضة.

التركيز الأفضل يعد ميزة إضافية، بحيث يمكن أن يضيف آي-فون 12 برو المزيد من بيانات الصور بفضل المسح ثلاثي الأبعاد. وعلى الرغم من أن هذا العنصر لم يتم تحديده بعد، إلا أن كاميرا TrueDepth الأمامية التي تستشعر العمق قد تم استخدامها بطريقة مماثلة مع التطبيقات، ويمكن لمطوري الطرف الثالث الغوص في بعض الأفكار باستخدام تلك التقنيات الجديدة وهذا ما سنراه بالفعل.

كما أنه يفيد الواقع المعزز بشكل كبير

يسمح Lidar لآي-فون 12 برو بتشغيل تطبيقات الواقع المعزز AR بسرعة أكبر، وإنشاء خريطة سريعة للمشهد لإضافة المزيد من التفاصيل. تستفيد الكثير من تحديثات الواقع المعزز في iOS 14 من lidar لانشاء كائنات افتراضية وإخفائها خلف أشياء حقيقية، ويصل الأمر إلى وضع كائنات افتراضية داخل مكونات غرفة أكثر تعقيدًا بدقة كبيرة.

يستخدم المطورون ليدار لمسح المنازل والمساحات وإجراء عمليات مسح ضوئي يمكن استخدامها ليس فقط في الواقع المعزز، ولكن لحفظ نماذج الأماكن بتنسيقات مثل CAD.

لقد تم اختباره على إحدى ألعاب أبل أركيد، وهي Hot Lava، والتي تستخدم بالفعل lidar لمسح الغرفة وكل عوائقها. وتم التمكن من وضع أشياء افتراضية على السلالم، وإخفاء أشياء خلف أشياء واقعية في الغرفة.

نتوقع المزيد من تطبيقات الواقع المعزز AR التي ستبدأ في إضافة دعم Lidar وبشكل أكثر احترافية وتتجاوز ما ذكرنا.

تحلم العديد من الشركات بسماعات رأس تجمع بين الكائنات الافتراضية والأشياء الحقيقية، حيث ستعتمد نظارات الواقع المعزز، التي يعمل عليها Facebook و Qualcomm و Snapchat و Microsoft و Magic Leap وعلى الأرجح أبل وغيرهم، ستعتمد على وجود خرائط ثلاثية الأبعاد متقدمة للعالم ووضع كائنات افتراضية عليها.

يتم الآن إنشاء هذه الخرائط ثلاثية الأبعاد باستخدام ماسحات ضوئية ومعدات خاصة، تقريبًا مثل إصدار المسح العالمي لسيارات خرائط Google. ولكن هناك احتمال أن تساعد الأجهزة الخاصة الناس في النهاية على جمع هذه المعلومات أو إضافة بيانات إضافية أثناء التنقل.

مرة أخرى، فإن سماعات الرأس AR مثل Magic Leap و HoloLens تفحص بيئتك مسبقًا قبل وضع الأشياء فيها، وتعمل تقنية AR المجهزة بنظام lidar من أبل بنفس الطريقة. بهذا المعنى، فإن آي-فون 12 و 12 برو وآي-باد برو يشبهان سماعات AR بدون جزء سماعة الرأس. وهذا بالطبع يمكن أن يمهد الطريق لشركة أبل لصنع نظاراتها الخاصة في النهاية.

أبل ليست أول من اكتشف تقنية مثل هذه على الهاتف

كان لدى جوجل نفس الفكرة عندما تم إنشاء مشروع Tango، وهو يستهدف في الأساس تقنيات للواقع المعزز، وكانت النماذج الأولية لمشروع تانغو كانت عبارة عن أجهزة محمولة ذكية “هواتف وأجهزة لوحية” قائمة على نظام أندرويد تمتلك خاصية الإدراك المكاني للبيئة التي يتواجد فيها الجهاز بواسطة تتبع الحركة الثلاثية الأبعاد والتقاط شكل البيئة المحيطة في الوقت الحقيقي، وذلك عن طريق إضافة نظام رؤية متطور ومعالجة للصورة و أجهزة استشعار متخصصة، وكان يستخدم فقط على هاتفين منها هاتف Lenovo Phab 2 Pro.

تحتوي مجموعة الكاميرا المتقدمة أيضًا على مستشعرات الأشعة تحت الحمراء ويمكنها رسم خرائط للغرف، وإنشاء عمليات مسح ثلاثية الأبعاد وخرائط عميقة للواقع المعزز وقياس المساحات الداخلية. وكانت هذه الهواتف المجهزة بتقنية Tango قصيرة العمر، واستبدلت بخوارزميات الرؤية الحاسوبية والذكاء الاصطناعي التي قامت باستشعار العمق التقديري من خلال الكاميرات دون الحاجة إلى إضافة مستشعرات حقيقية، كما حدث في هواتف بيكسل من جوجل.

وبهذا يعد آي-فون 12 برو هو من أعاد صياغة تقنية الـ Lidar ، ويعمل على تقديمها بشكل أفضل وجلب تقنية أسس لها منذ زمن طويل وامتدت إلى صناعات ضرورية أخرى، والآن يتم دمجها في السيارات ذاتية القيادة وأجهزة الرأس الخاصة بالواقع المعزز AR وغير ذلك الكثير.